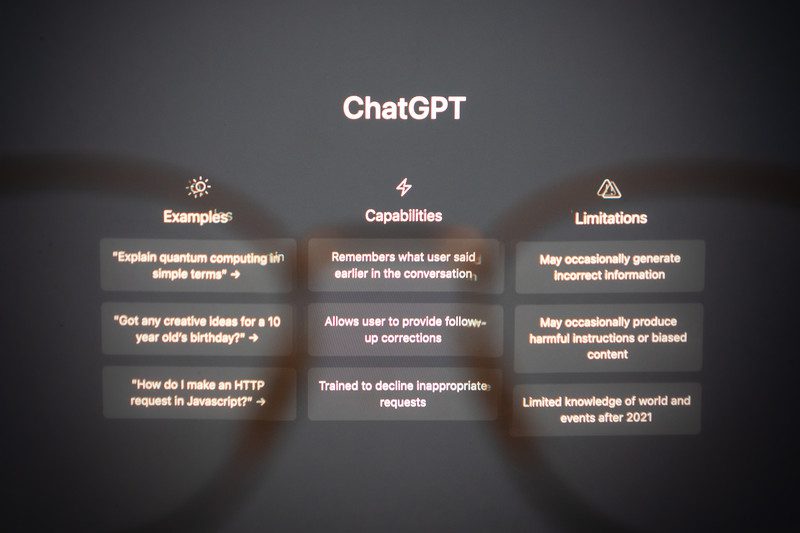

En las últimas semanas, el mundo se ha visto cautivado por una extraordinaria herramienta de inteligencia artificial. ChatGPT puede generar todo tipo de textos, como ensayos, artículos periodísticos e incluso poemas. Es divertido y fascinante. Y, sin embargo, ChatGPT también está planteando cuestiones difíciles, como su potencial para la desinformación, que da quebraderos de cabeza a los legisladores.

Bruselas se encuentra actualmente en una encrucijada para abordar las cuestiones de enorme importancia sobre el papel que vemos para la IA en nuestra sociedad y, lo que es más importante, dónde tenemos que trazar las líneas rojas.

-

Los consumidores tampoco suelen confiar en que las autoridades ejerzan un control efectivo sobre los sistemas de IA (Foto: Jonathan Kemper)

Hace casi dos años que la Comisión Europea publicó un proyecto legislativo para regular los sistemas de IA, y los debates en las instituciones de la UE están llegando a la fase crítica. El Parlamento Europeo expondrá finalmente en las próximas semanas lo que cree que debería hacer la ley sobre IA.

Los eurodiputados tienen que hacerlo bien y proteger a las personas de los usos nocivos de los sistemas de IA, que podrían afectar significativamente a nuestras vidas como ciudadanos y consumidores, y a nuestra sociedad en su conjunto. Hasta ahora, ni la Comisión ni los gobiernos nacionales han hecho lo suficiente. Los eurodiputados deben pensar detenidamente cómo queremos utilizar la tecnología de IA en nuestra sociedad, y cómo no.

¿Los consumidores en manos de la IA?

Y es que los sistemas de IA pronto harán mucho más que escribir textos divertidos o elegantes como hace ChatGPT.

En el mercado del alquiler de alojamientos, Airbnb ya ha patentado un software de IA que supuestamente puede predecir los rasgos de una persona y sus acciones basándose en los datos que posee sobre ella, por ejemplo de las redes sociales.

Un sistema de IA de este tipo determinaría cuánto paga un consumidor, o incluso si podría acceder a un alojamiento concreto.

Cabe preguntarse cómo puede saber el consumidor si está siendo discriminado y qué criterios se utilizan para tomar esta decisión. En concreto, deberíamos preguntarnos si queremos que las empresas nos marquen socialmente.

La IA se utiliza cada vez más en el sector de los seguros para calcular cuánto costará la prima de un seguro de coche o de hogar, o si se debe ofrecer una póliza al cliente.

Los vastos conjuntos de datos en los que estos sistemas podrán basarse y analizar a velocidades cada vez más rápidas conducirán probablemente a precios cada vez más personalizados, sin que podamos saber qué factores se tienen en cuenta para esta personalización, o impugnar la decisión de la IA.

La IA podría tener un impacto devastador en las finanzas personales de algunas personas si los datos son incorrectos o existen sesgos negativos en el razonamiento del algoritmo.

En 2021, Frances Haugen reveló cómo los algoritmos de Facebook estaban causando daños físicos y psicológicos a los adolescentes mediante la formación de adicciones y hábitos. TikTok está siendo investigada en EEUU por problemas similares.

Estos algoritmos necesitan un mayor escrutinio público, y las autoridades públicas deben reafirmar el control sobre ellos si una empresa no toma medidas correctivas.

La solución: regular allí donde es probable que se produzcan daños.

Nuestra propia encuesta de 2020 mostró que los consumidores, a pesar de ver beneficios en el despliegue de la IA, también tenían poca confianza en que los sistemas de IA respetaran sus datos personales y les preocupaba que pudiera manipular sus decisiones. En general, los consumidores tampoco confían en que las autoridades ejerzan un control efectivo sobre los sistemas de IA.

En las próximas semanas, el Parlamento Europeo debe aumentar su ambición e impulsar una protección eficaz de los consumidores en la era de la IA.

En primer lugar, el Parlamento debe prohibir los sistemas de IA que conlleven un riesgo inaceptable de daño para los consumidores.

El scoring social por parte de las empresas, en el que se mercantiliza a los consumidores tanto como el producto o servicio, no tiene cabida en una sociedad en la que valoramos el derecho de las personas a la privacidad, la autonomía y la dignidad.

El reconocimiento facial por parte de empresas en espacios de acceso público, donde se detectan y escrutan nuestros rostros y cada uno de nuestros movimientos, también debería estar prohibido. El valor comercial de que las empresas sepan lo que hacemos y adónde vamos puede ser alto, pero debemos ser libres de ir adonde queramos sin que las cámaras y sensores de una empresa nos sigan. El respeto de los derechos fundamentales de privacidad y autonomía debe prevalecer sobre las llamadas ideas empresariales innovadoras.

En segundo lugar, el Parlamento de la UE tiene que asegurarse de que se amplía el ámbito de aplicación de la ley a los sistemas de IA de alto riesgo.

Los sistemas que puedenque causen daños a los consumidores deben incluirse en esa categoría para que tengan que cumplir obligaciones específicas. Los sistemas de recomendación de contenidos, los asistentes domésticos, los contadores inteligentes, todos los seguros minoristas que utilizan sistemas de IA y cualquier IA susceptible de ser utilizada por niños deben considerarse de alto riesgo.

En tercer lugar, todos los demás tipos de sistemas de IA deben respetar ciertos principios generales, como la imparcialidad, la transparencia y la responsabilidad, que son parte integrante de nuestra sociedad. ChatGPT no debe ser una excepción. La Ley de IA de la UE debe ser una norma flexible, preparada para el futuro, que también pueda abordar los riesgos a medida que surjan.

Por último, una tecnología de esta complejidad y alcance no puede desplegarse sin otorgar derechos sólidos a las personas que se verán afectadas por ella. Estos derechos deben incluir el derecho a oponerse a una decisión tomada por un sistema de IA y a recibir una explicación, pero también a solicitar una reparación a la empresa en caso de que su sistema de IA haya causado daños. Y lo que es más importante, los consumidores deben poder acudir a los tribunales como grupo para obtener una reparación colectiva.

La pelota está ahora en el campo del Parlamento Europeo. Esta nueva ley sobre IA es una gran oportunidad para que la UE fomente y lidere la innovación socialmente valiosa. Debería prohibir la tecnología que pueda causar daños graves. Debe situar a los consumidores, los ciudadanos y las democracias en el centro de la era de la IA. ChatGPT no es la única aplicación de IA que se nos viene encima.